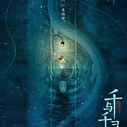

Исследователи испугались собственной разработки, предупредив об опасности языковой модели ИИ

Создатели революционной системы искусственного интеллекта, которая может писать новостные сюжеты и художественные произведения, предприняли необычный шаг и решили не публиковать свои исследования, опасаясь возможного злоупотребления.

В OpenAI — некоммерческой исследовательской компании, поддерживаемой Илоном Маском, Рейдом Хоффманом, Сэмом Альтманом и другими — говорят, что новая модель ИИ, получившая название GPT2, настолько хороша, а риск злоумышленного использования настолько высок, что организации пришлось нарушить обычную практику выпуска полноценных исследований для общественности, чтобы должным образом обсудить последствия технологического прорыва. Несмотря на то, что исследователи до конца не уверены в правильности принятого решения, они считают, что ИИ-сообществу в конечном итоге необходимо будет обдуманно решить вопрос о нормах публикации в определенных областях исследований.

Generative Pre-trained Transformer-2 представляет собой огромную преобразовательную языковую модель с 1,5 миллиардами параметров, обученная посредством набора данных из 8 миллионов веб-страниц. GPT-2 обучается с простой целью: предсказать следующее слово, учитывая все предыдущие слова в пределах некоторого текста. Разнообразие набора данных приводит к тому, что эта простая цель содержит естественные демонстрации многих задач в разных областях. При использовании простого для генерации нового текста, ИИ-модель способна к написанию правдоподобных пассажей, которые соответствуют стилистике и тематике оригинального текста. GPT2 редко показывает какие-либо причуды, которыми выделялись предыдущие системы искусственного интеллекта — как, например, забывание того, о чем она пишет в середине абзаца, или искажение синтаксиса длинных предложений.

Как бы то ни было, общие языковые модели могут иметь значительные последствия, а также иметь разнообразные области краткосрочных применений. Исследователи предвидят, как подобные GPT-2 системы могут быть использованы для создания бесконтрольного перевода между языками и улучшения систем распознавания речи.

Представленные в блоге данные в сочетании с более ранними результатами по искусственным изображениям, аудио и видео подразумевают, что технологии снижают стоимость создания поддельного контента и проведения кампаний по дезинформации. Исследователи призывают скептически относиться к найденным в интернете текстам — так же, как феномен deep fakes требует большего скепсиса в отношении изображений.

Лучший комментарий